スイス チーズ モデル - 「スイスチーズモデル」とは?安全な情報セキュリティのための考え方

スイスチーズモデル

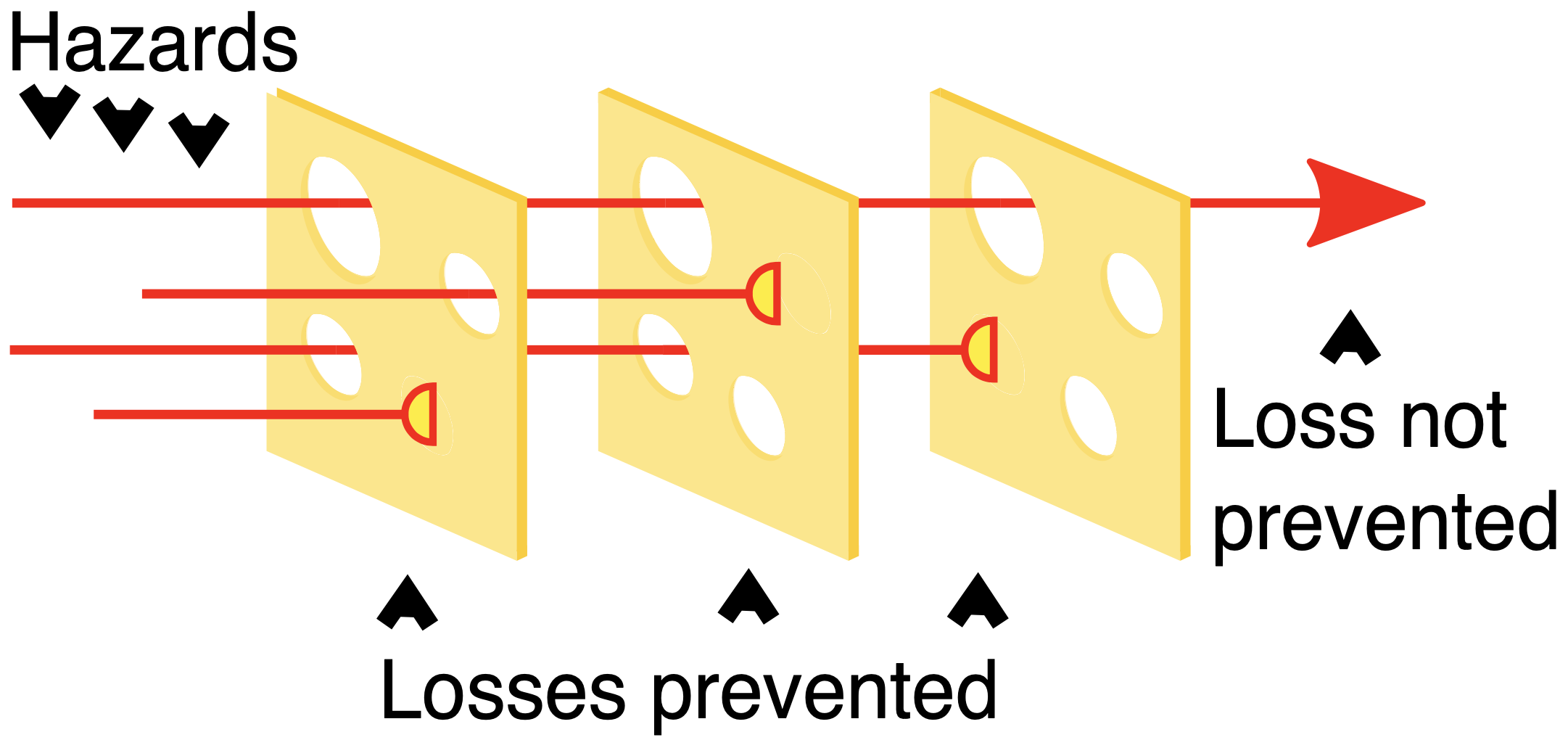

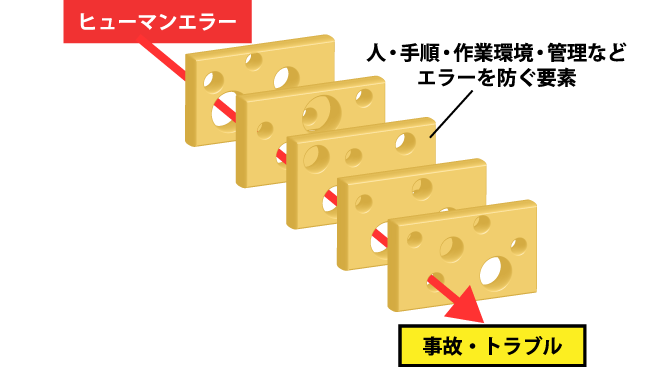

その要因がいくつも存在する中で、エラーが生じるとそれが引き金となり事故が発生することになります。

人はいかに説明書きを読まず、日頃の習慣に従って漫然と反射的に行動しているかを、身を持って実感できる機会となるだろう。

患者の取り違えを起こしかねない患者移送,引き継ぎの運用システムであった。

英国ワトフォード出身の心理学者・ヒューマンエラーの研究者。

スイスチーズモデルの概念とは?ヒューマンエラー対策を知る | 幻冬舎ゴールドライフオンライン

The Contribution of Latent Human Failures to the Breakdown of Complex Systems. 歩行者が横断歩道を渡ろうとしており危険• 安全管理においては、このスイスチーズモデルの考え方が重要視されています。

また、従業員の教育・指導もリスク回避の壁として有効です。

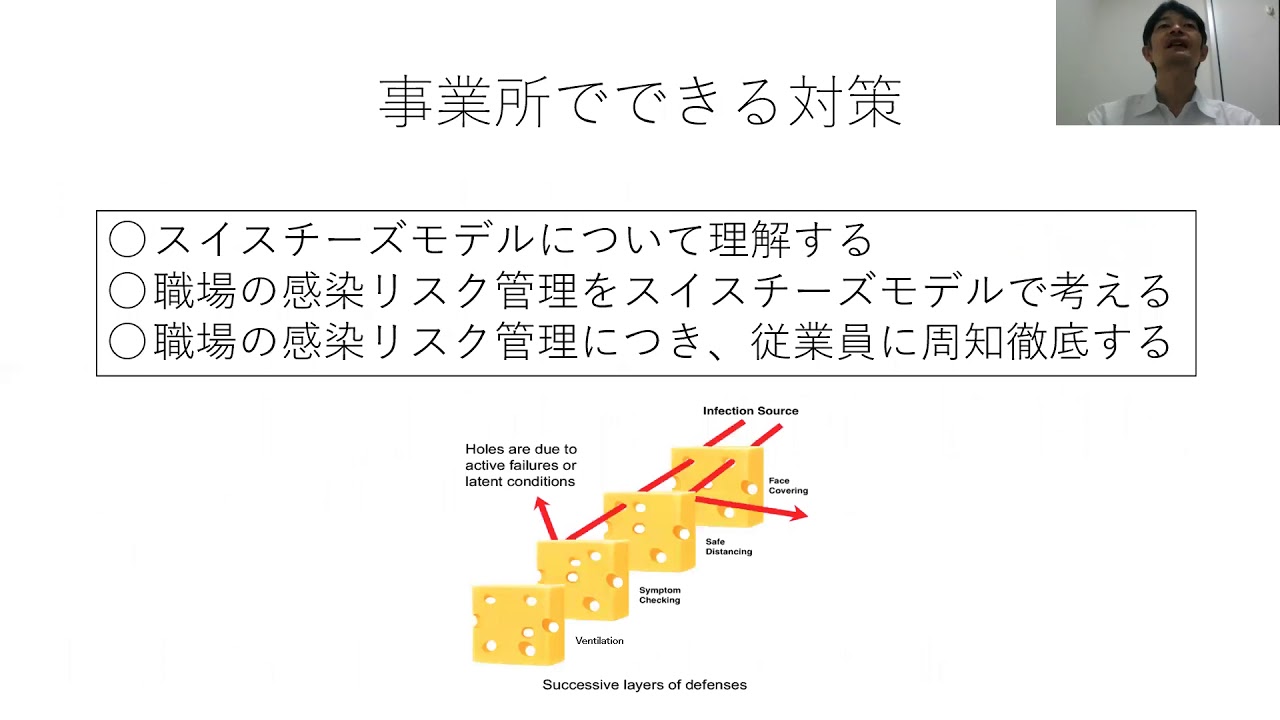

その概念を図式化したものが【スイスチーズモデル】です。

試行錯誤しながら、自分の環境に適した対策を常日頃から考えておきましょう。

【寄稿】第一線病院での医療の安全・質向上活動 第2回 スイスチーズを見たことがありますか|リクルートドクターズキャリア

コミュニケーション 【3枚目のチーズ】• これには人為的なヒューマンエラーだけでなく、システムのエラーや設備等のエラーも含みます。

「要因」とは結果に対して間接的に影響を与えるものです。

この考え方は、情報セキュリティにおいても適用できます。

思い違い、勘違い• ジェームズ・リーズンは、個別的に発生するエラーへの着目ではなく、連鎖的あるいは組織的に発生するエラーに着目することによって事故の多くはあくまでも「 組織事故」であるとしたのです。

人間工学に関するモデル5選

これらの典型値から単純な意思決定と比較照合判断の所要時間を決定できます。

第3は、わかりやすくする できないようにできない場合は、間違えないためにわかりやすくします。

と言うものです。

こうした穴が開いた防護壁を例えて、スイスチーズモデルといいます。

スイスチーズモデルに関してざっくりまとめる

それを図にしたのが以下の図です。

転職を支援するキャリアアドバイザーが解決した事例から成功のヒントを探る。

1962年に英国マンチェスター大学を卒業、1967年博士号を取得。

具体的な業務内容、専属と嘱託の違い、必要な要件は何かなど、業界の動向と現役産業医の事例を紹介する。

スイスチーズモデルで組織事故を考える

さらに組織的な安全への取り組みも防護壁といえます。

人間が機器を使いたいと思っている事柄は人間側の心理的世界にあり、実際に機器を使って行うタスクは機器側の物理的世界にあります。

システムの不整備 思い違いや勘違い、ルール違反は人為的なミスはヒューマンエラーと呼ばれます。

図表6がその結果であるが、既製のイラストとは異なり、現実の写真は情報量が多く、一見関係ないような部分に潜む誰も予想しないような危険を指摘する人が出てくる。

- 関連記事

2021 tmh.io